Appearance

深度学习基础

一、概念

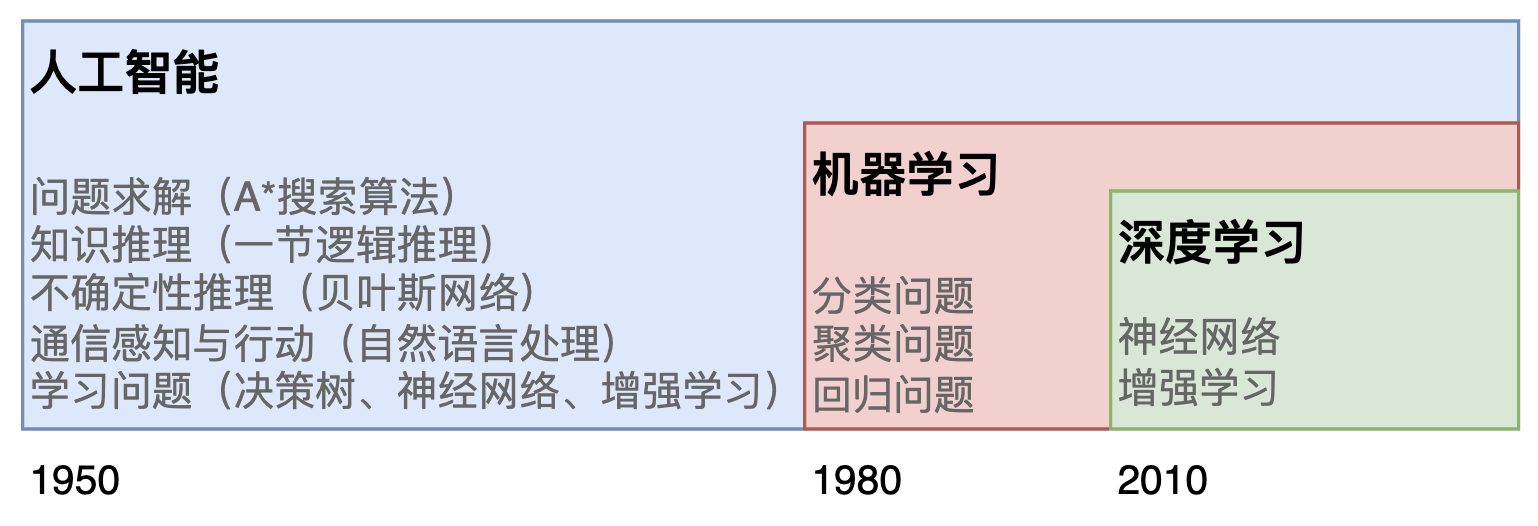

深度学习(DL,Deep Learning)是机器学习(ML,Machine Learning)领域中一个新的研究方向,它被引入机器学习使其更接近于最初的目标——人工智能(AI,Artificial Intelligence)。

- 深度学习是学习样本数据的内在规律和表示层次,这些学习过程中获得的信息对诸如文字、图像和声音等数据的解释有很大的帮助。

- 深度学习的最终目标是让机器能够像人一样具有分析学习能力,能够识别文字、图像和声音等数据。

- 深度学习是一个复杂的机器学习算法,在语音和图像识别方面取得的效果,远远超过先前相关技术。

- 深度学习在搜索技术,数据挖掘,机器学习,机器翻译,自然语言处理,多媒体学习,语音,推荐和个性化技术,以及其他相关领域都取得了很多成果。

- 深度学习使机器模仿视听和思考等人类的活动,解决了很多复杂的模式识别难题,使得人工智能相关技术取得了很大进步。

总结,深度学习是自动提取特征,不同于机器学习的人工提取特征。

人工提取特征时,人是知道为什么提取这个特征的,而神经网络则是通过训练去尽可能贴近训练集,它确实也是做到了,但是说不出为什么,它为什么是这样弄,说不出它的权重为什么是这样,所以你也没法很好地手动去改去让它变得更好。它是自动提取特征你也说不清楚它提取了哪些特征,感觉更像是一种非线性模型,它是综合出来地效果,你没法去把它内部拆开一个个分析其内部的一部分的功能。它是一个整体的综合性的体现。

- 模型:神经网络

- 学习准则:交叉熵损失

- 优化:随机梯度下降

二、与机器学习区别

| 区别 | 机器学习 | 深度学习 |

|---|---|---|

| 特征提取与学习 | 通常依赖于特征工程 (feature engineering),这意味着专家需要人为地对数据进行提炼和清洗,选择或构造最相关的特征来训练模型。 | 利用表示学习 (representation learning),机器学习模型自身能够从原始数据中自动学习和提取有用的特征。这种方法不需要手动选择特征、压缩维度或转换格式。 |

| 数据依赖性 | 通常需要大量的标记数据来训练模型,因为模型的性能很大程度上取决于输入的数据质量。 | 对于深度学习,尤其是当使用无监督学习方法时,可以处理大量未标记的数据。此外,深度网络的多层结构使其能够学习数据的多层次表示。 |

| 计算资源 | 通常需要的计算资源较少,因为它们的模型结构简单。 | 由于其复杂的网络结构和大量的参数,深度学习模型通常需要更多的计算资源,如 GPU 加速。 |

| 模型可解释性 | 许多传统的机器学习算法(如决策树、支持向量机等)提供相对较高的模型解释性,因为它们的决策过程往往是直观的。 | 深度学习模型,尤其是深层神经网络,通常被视为“黑箱/黑盒”,因为它们的内部工作机制很难解释。 |

| 应用领域 | 广泛应用于各种领域,如金融、医疗、零售等,其中特征的选择和工程是关键步骤。 | 由于其强大的表示学习能力,尤其在图像识别、语音识别和自然语言处理等领域表现出色。 |

三、所属类别

机器学习按照方法主要可以分为两大类:

- 监督学习

- 无监督学习

其中监督学习主要由分类和回归等问题组成,无监督学习主要由聚类和关联分析等问题组成。

深度学习则属于监督学习当中的一种。

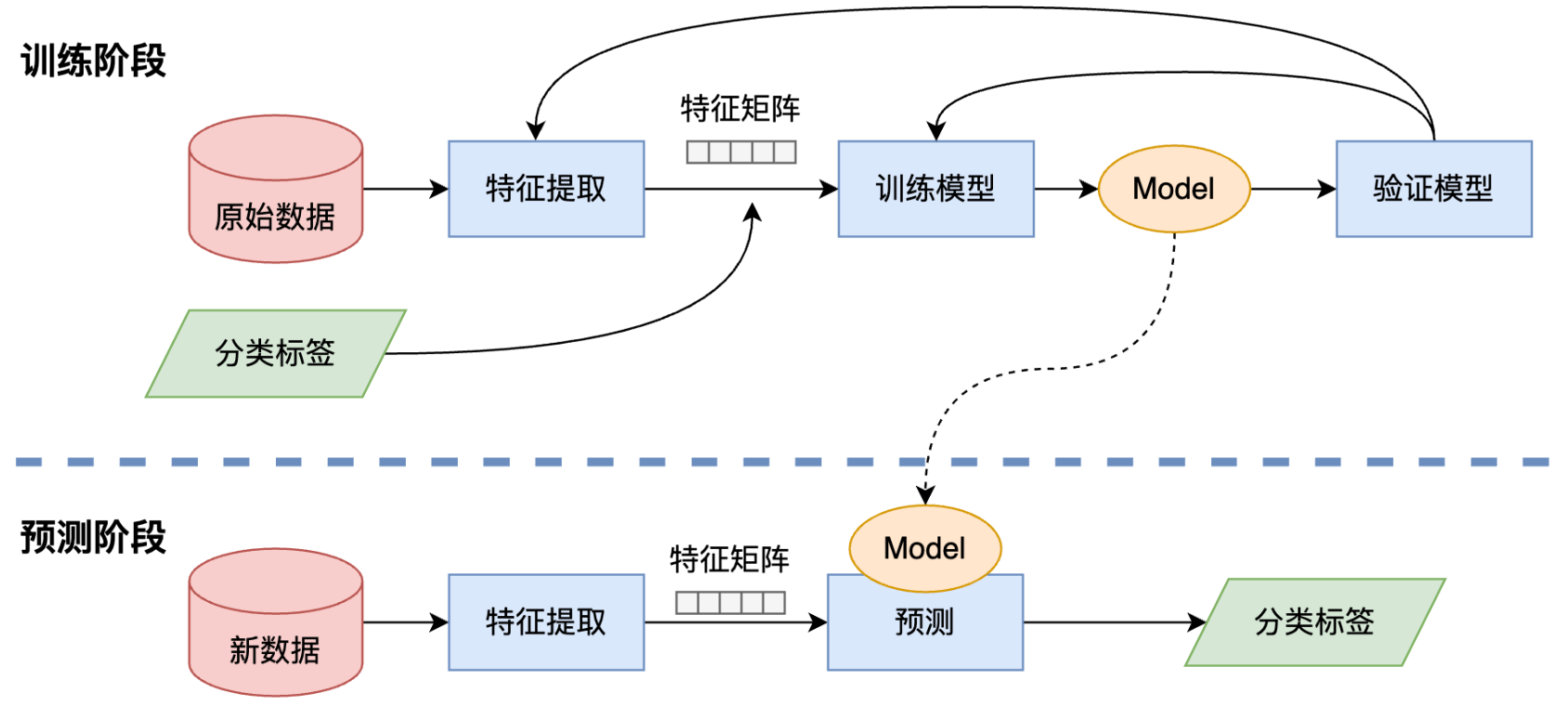

下图为监督学习的一般方法。

监督学习一般方法,分为训练阶段和预测阶段。

- 训练阶段:目标得到预测模型

- 预测阶段:使用训练模型对输入数据进行预测

随着深度学习的爆发,最新的深度学习算法已经远远超越了传统的机器学习算法对于数据的预测和分类精度。

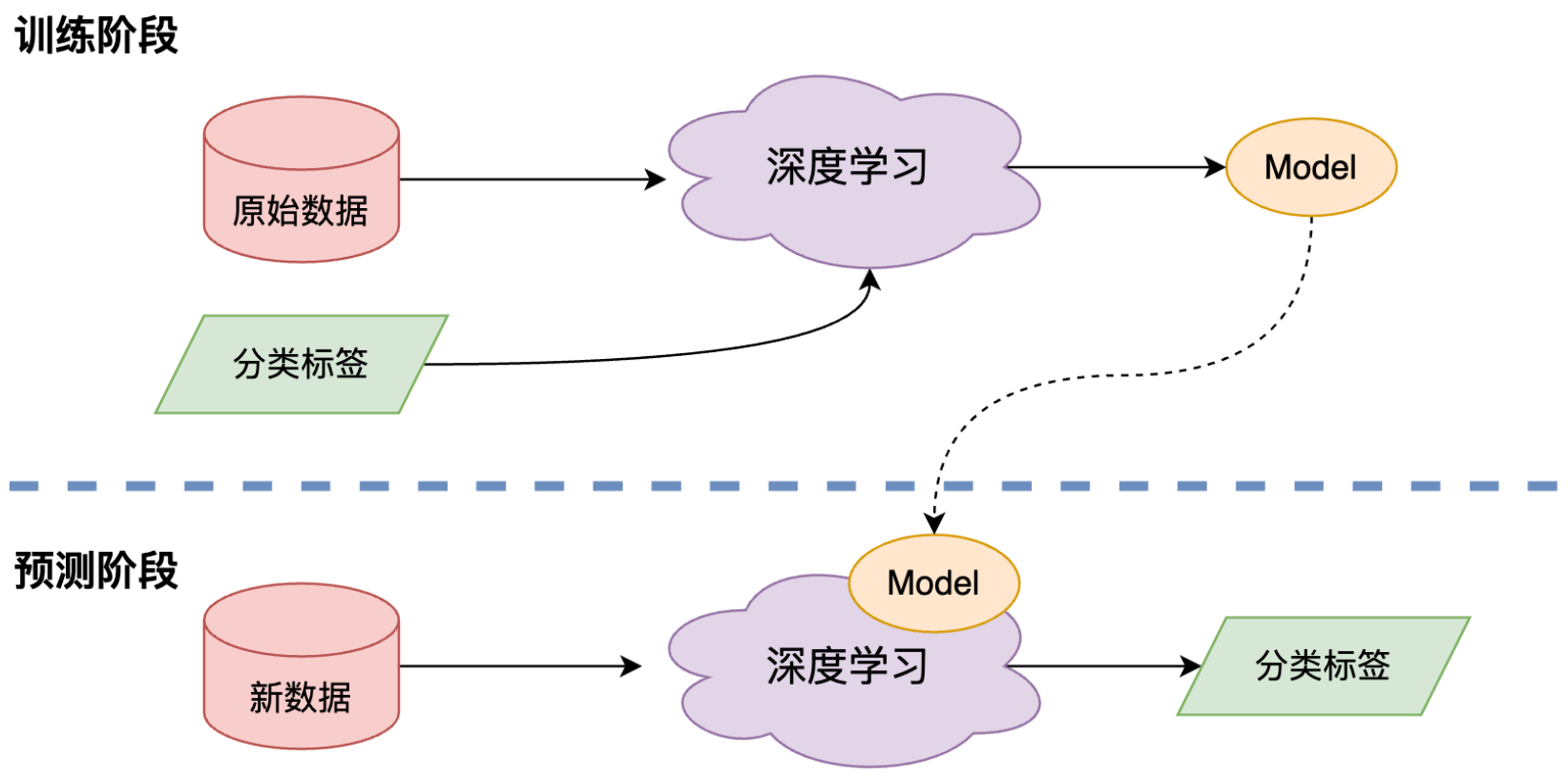

深度学习不需要我们自己去提取特征,而是自动地对数据进行筛选,自动地提取数据高维特征,下图为深度学习的一般方法。

与传统机器学习中的监督学习一般方法相比,少了特征工程,节约了工程师们大量工作时间。

四、与神经网络区别

深度学习的概念源于人工神经网络的研究,但是并不完全等于传统神经网络。

不过在叫法上,很多深度学习算法中都会包含”神经网络”这个词,比如:卷积神经网络、循环神经网络。

所以,深度学习可以说是在传统神经网络基础上的升级,约等于神经网络。

五、深度学习应用

神经网络应用的突破领域之一是控制论,神经网络有着一套完美的反馈机制,给控制论增添了不少色彩。而深度学习的出现就如寒武纪生命大爆发一样,前几年我们或许听到更多的是大数据处理、数据挖掘, 而如今在科技创新的生态中,几乎每个人都在谈论深度学习、人工智能。

随着大数据、云计算、互联网、物联网等信息技术的发展,泛在感知数据和图形处理器等计算平台推动以深度神经网络为代表的人工智能技术飞速发展,大幅跨越了科学与应用之间的技术鸿沟,诸如图像分类、语音识别、知识问答、人机对弈、无人驾驶等人工智能技术实现了重大的技术突破,迎来爆发式增长的新高潮。

接下来我们就通过几个方面来展示一下最近 10 年以来,深度学习方面所取得的部分有代表性的成就。

1、谷歌神经机器翻译

2016 年左右,谷歌宣布推出谷歌翻译新模式。谷歌公司详细描述翻译的网络架构——循环神经网络(RNN)。

最后的主要结果是:缩小了机器与人类在翻译准确性方面上的差距,达到了 55-85%(人们按照六分制进行评分)。

如果 Google 没有拥有的庞大数据集,那么很难重新呈现这个模型的高效果性。

2、WaveNet:原始音频的生成模型

DeepMind 的员工在他们的文章中报道了如何生成音频。简而言之,研究人员基于以前的图像生成方法(PixelRNN 和 PixelCNN)制作了一个自回归全卷积波网模型。

网络经过端到端的训练:输入文本,输出音频。研究得到了很好的结果,与人类相比,研究的结果差异减少了 50%,取得了较好的效果。

3、RNN:绘制草图

也许你已经看过 Quick,Draw!这个程序来自 Google,其目标是在 20 秒内绘制各种对象的草图让程序进行识别。

该公司收集了用户绘画的数据集,以教导神经网络绘制图片。

收集的数据集由 7 万张草图组成,最终可以公开使用。草图不是图片,而是图片的详细矢量表示(此时用户按下“铅笔”,在线条被绘制的地方释放,等等)。

研究人员使用 RNN 作为编码/解码机制,训练了序列到序列变分自动编码器(VAE)。

最终,与自动编码器相匹配的是,模型接收到一个潜在的向量,该向量表示原始图像的特征。

甚至可以执行向量运算创建出一直猪猫(那不就是橘猫咯):

4、GANs:生成对抗网络

深度学习中最热门的话题之一就是生成对抗网络(GAN)。生成对抗网络(GAN) 是一类用于无监督机器学习的神经网络。它们有助于解决诸如描述图像生成,从低分辨率图像获取高分辨率图像,预测哪种药物可以治疗某种疾病,检索包含给定模式的图像等任务。大多数情况下,这个概念用于处理图像。

如果在训练期间像潜在向量传输一个受控的参数,那么当生成它时,你就可以更改它,从而管理图片中的必要图像。这种方法称为条件 GAN。

“使用条件生成性对抗网络进行面部老化”这篇文章的作者也是如此。研究人员在 IMDB 数据集上堆引擎进行了已知演员年龄的训练,然后给了研究人员改变人脸年龄的机会。

5、图像处理

图像识别、图像分割等领域。

6、自动驾驶

自动驾驶就是车辆在无驾驶员操作的情况下自行实现驾驶,它是车辆的能力。

比如扫地机器人在扫地的时候就是在自动驾驶。

7、人脸检测

8、机器人

9、医疗健康诊断

百度开源的肿瘤检测模型。

六、深度学习总结

- 模型框架:神经网络

- 学习策略:交叉熵损失等

- 优化算法:随机梯度下降算法